La IA permite abrir una panoramica nueva para profesores y estudiantes, de forma que asistiremos aldesafio de la coordinación del sistema educativo con la implantación de esta nueva tecnología. Adelantandose a los problemas de esta coordinación, a finales de 2022, la Comisión Europea preparó la

guía “Directrices éticas sobre el uso de la Inteligancia Artificial (IA) y los datos en la educación y formación para los educadores”

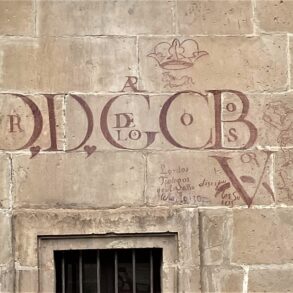

LUIS VÁZQUEZ MARTÍNEZ

Con el comienzo de la Segunda Guerra Mundial, Estados Unidos se fijó el objetivo de ser los primeros

en construir armas nucleares. Es de destacar que un gran número de científicos apoyaron esta decisión,

desde A. Einstein a E. Fermi. Así surgió el Proyecto Manhattan, dirigido por el general Leslie Groves,

e implementado en el Laboratorio Nacional de Los Álamos (Nuevo México) El Laboratorio fue dirigido

por el Profesor Julius Robert Oppenheimer (Nueva York, 22 de abril de 1904-Princeton, Nueva

Jersey, 18 de febrero de 1967) fue un físico teórico estadounidense de origen alemán y profesor de

física en la Universidad de California en Berkeley.

El 16 de julio de 1945 se realizó con éxito la primera prueba de la bomba atómica, a la que nombraron Trinity. Tres semanas después, el país fabricó Little Boy y el Fat Man, los artefactos que en agosto de ese mismo año fueron lanzados en las ciudades japonesas de Hiroshima y Nagasaki. Este éxito de Oppenheimer se convirtió en su gran problema personal que le llevó a declarar “Ahora me he convertido en la muerte, el destructor de mundos”.

Precisamente, actualmente nos encontramos ante una nueva tecnología, la Inteligencia Artificial (IA), que puede remodelar la evolución de la Humanidad como ocurrió con el comienzo de la Era Atómica. La

Inteligencia Artificial representa simultáneamente una gran oportunidad y un gran riesgo. Para encontrar el equilibrio correcto entre ambos aspectos, es de resaltar que el pasado 21 de Julio de 2023 se ha celebrado una reunión en la Casa Blanca de los dirigentes de las siete compañías importantes en el desarrollo de IA : Amazon, Anthropic, Google, Inflection, Meta, Microsoft y OpenAI.

La idea fundamental es crear un entorno de colaboración entre ellas y con el gobierno para evitar derivaciones que puedan resultar peligrosas. En este contexto, se han de destacar tres objetivos principales: Garantia de los productos. Protección de la seguridad nacional. Confianza del público.

Y el compromiso de las siete impotantes compañia ha sido

-Producir tests sobre la seguridad de los productos. Relevancia de expertos independientes.

-Condividir las informaciones con el gobierno que es el gestor de los riesgos.

-Garantizar a los consumidores la posibilidad de identificar fácilmente las contenidos de los

productos de la IA.

-Regularmente, hacer publicos las capacidadesy limitaciones de sus sistemas.

-Poner a disposición de la Sociedad instrumentos para afrontar sus retos mas graves, desde los cambios climáticos a la cura de enfermedades como el cancer.

-Realizar investigaciones sobre los riesgos para la privacidad y las discriminaciones.

La IA permite abrir una panoramica nueva para profesores y estudiantes, de forma que asistiremos aldesafio de la coordinación del sistema educativo con la implantación de esta nueva tecnología. Adelantandose a los problemas de esta coordinación, a finales de 2022, la Comisión Europea preparó la

guía “Directrices éticas sobre el uso de la Inteligancia Artificial (IA) y los datos en la educación y formación para los educadores”.

La IA permitirá utilizar herramientas tanto para facilitar las tareas administrativas asi como facilitar la creación de entornos educativos mas concretosy personalizados a la vez que universales. La personalización del aprendizaje es uno de los aspectos más importantes de la IA. Todo ello basado en que la IA facilitará la utilización de gran cantidad de datos que permitirán comparar diferentes escenarios de docencia y optimizar el más apropiado en cada caso teniendo en cuenta los recursos correspondientes.

En este contexto, surge el problema ético y transparente del uso de la IA en la educación, en particular para la realización de tareas y trabajos. Todo esto va a implicar una mayor presencia física del profesorado en el control y seguimiento del trabajo del alumno. A la vez se necesitará un control de la calidad y autoria de los textos y medios audiovisuales utilizados. Como muestra de lo que puede generar

la IA, tenenos el ejemplo de la participación falsa de Jeff Bezos y Elon Musk en Star Trek donde nunca

actuaron.

LUIS VÁZQUEZ MARTÍNEZ Departamento de Análisis Matemático y Matemática Aplicada

Facultad de Informática

Universidad Complutense de Madrid